50亿的表添加索引我做过,大概一个多小时吧

是的,可以暂停这个功能感觉挺不错的

啊 这么短吗,不是一天?

是否可以按分区来建索引?

低峰期、备份、从库演练

这个最后有添加好吗

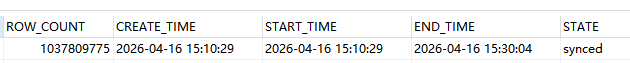

刚做的添加索引,10亿数据20分钟加完

最佳实践有没有注意或者优化的

大佬 集群扫描配置

多少字段?

最好分区做

这个需要综合考虑,磁盘的IO速度和CPU内存足够。还有的是字段的大小,如果int型会比较快

硬件配置比较优秀

是的,速度肯定和硬件配置也有关系

10亿可以加这么快的吗

你这50亿的数据是从哪里搞来的,是测试环境还是生产环境呢

很快了,棒!

有什么技巧

如果有测试环境,同表同数据的方式先测试验证一下。做过差不多2亿数据的加索引,用了有20分钟的样子

可以优化参数,提升创建索引速度,这个参数默认值为4

set global tidb_ddl_reorg_worker_cnt=8;