一个好的问题描述有利于社区小伙伴更快帮你定位到问题,高效解决你的问题

【TiDB 使用环境】生产环境 /测试环境

【TiDB 版本】

【部署方式】云上部署(腾讯云 标准型SA5 16C32G)

【操作系统/CPU 架构/芯片详情】

【机器部署详情】CPU大小/内存大小/磁盘大小

【集群数据量】

【集群节点数】

【问题复现路径】做过哪些操作出现的问题

【遇到的问题:问题现象及影响】

【资源配置】进入到 TiDB Dashboard -集群信息 (Cluster Info) -主机(Hosts) 截图此页面

【复制黏贴 ERROR 报错的日志】

【其他附件:截图/日志/监控】

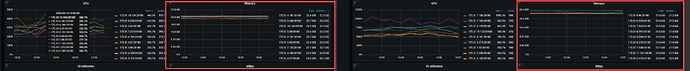

目前的问题是,生产环境有两套TIDB集群,tikv节点的配置都是 16C32G 的标准型SA5 云主机。storage.block-cache 相关的配置都一样,但是两套集群的 Tikv 内存使用率相差挺大,一个平均在80% ,一个平均在85%

相关的背景信息如下

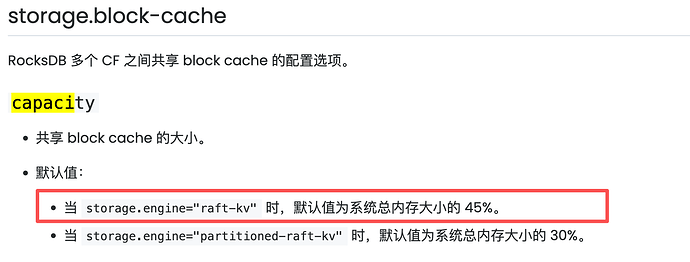

1、tiup cluster show-config xxx中关于 storage.block-cache.capacity 的配置如下

server_configs:

tidb: {}

tikv:

raftstore.capacity: 0

readpool.coprocessor.use-unified-pool: true

readpool.storage.use-unified-pool: true

2、TIDB集群中查看tikv角色的 storage.block-cache的配置如下

| tikv | x.x.x.x:20160 | storage.block-cache.capacity | 14867282534B |

| tikv | x.x.x.x:20160 | storage.block-cache.high-pri-pool-ratio | 0.8 |

| tikv | x.x.x.x:20160 | storage.block-cache.memory-allocator | nodump |

| tikv | x.x.x.x:20160 | storage.block-cache.num-shard-bits | 6 |

| tikv | x.x.x.x:20160 | storage.block-cache.shared | null |

| tikv | x.x.x.x:20160 | storage.block-cache.strict-capacity-limit | false |

+------+---------------------+-------------------------------------------+--------------+

3、主机节点总内存是32G,这里storage.block-cache.capacity 采用默认的 45%, 是14.4G

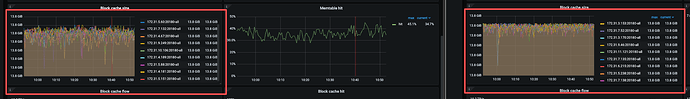

4、 然后在 Grafana的 TiKV-Detail面板看到 两个集群的 Block Cache Size 使用都在 13.8G左右

5、但是集群Tikv的内存使用有“异常“的集群最大也是24.2G(24.2/32=75.6%)和 当前集群实际的主机内存最大88%,相差了 13% 大约4G

核心疑问

1、storage.block-cache.capacity的14.4(实际是13.8GB) 和 24GB (最大24.2G,最小22.5G)的差异来源

2、24GB的75.6% 和总内存的 88%的差异是差在哪里了?