g.7z (1.7 MB)

什么类型的磁盘,配置什么样,有没有检查过磁盘

188那台,有热点吧

普通的磁盘,没检查过磁盘,云虚拟机

我这只能在服务器上看,别地方没权限哎

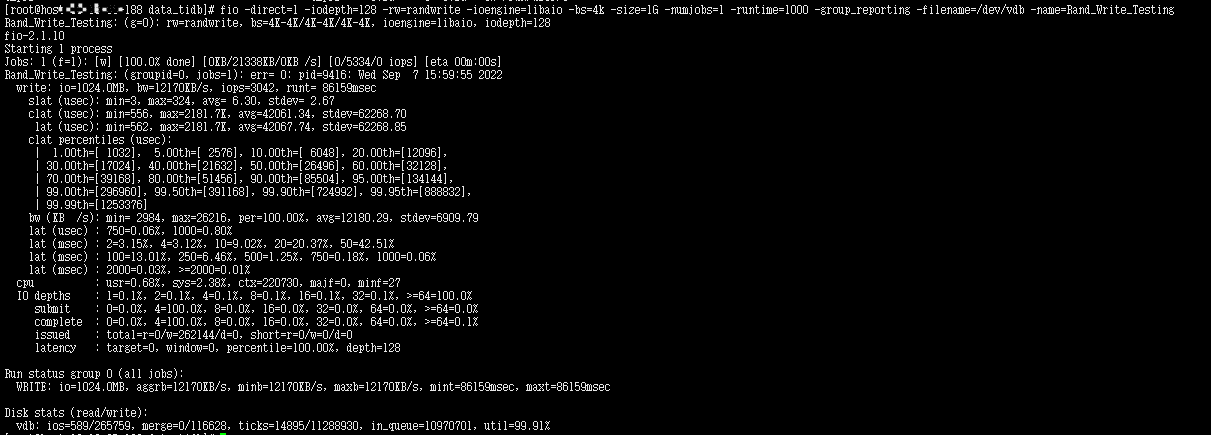

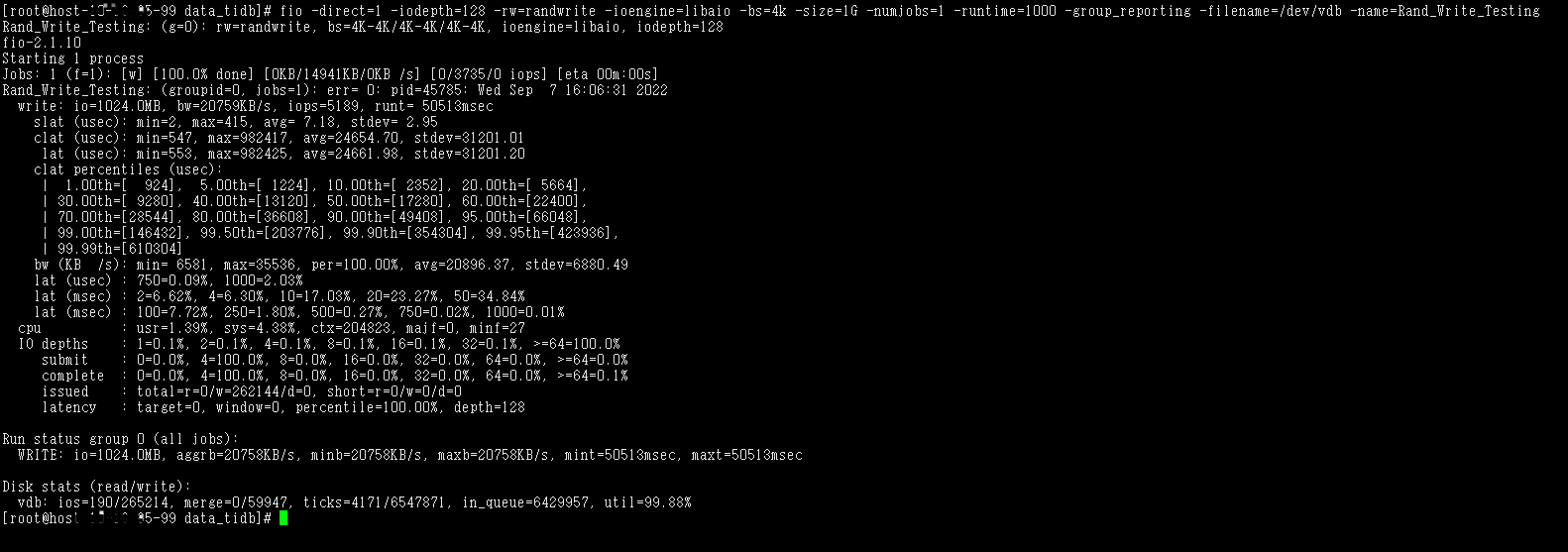

试试和其他2台 dd 写8k块,看上速度有差异没,这是连续写不一定能体现出来,或者用fio这类工具测下

感觉是热点都集中一台上了吧 曾经也遇到过 扩容是最无脑的方式![]()

现在什么情况? 查到哪里问题了吗?

kv 节点的 负载高吗? 每个节点都相差大吗?

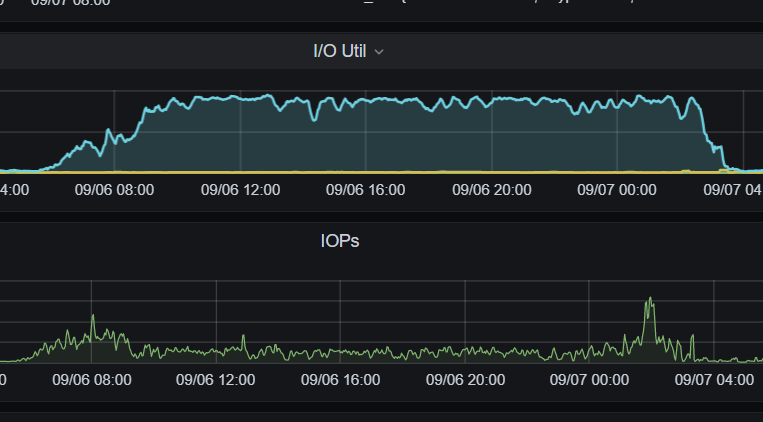

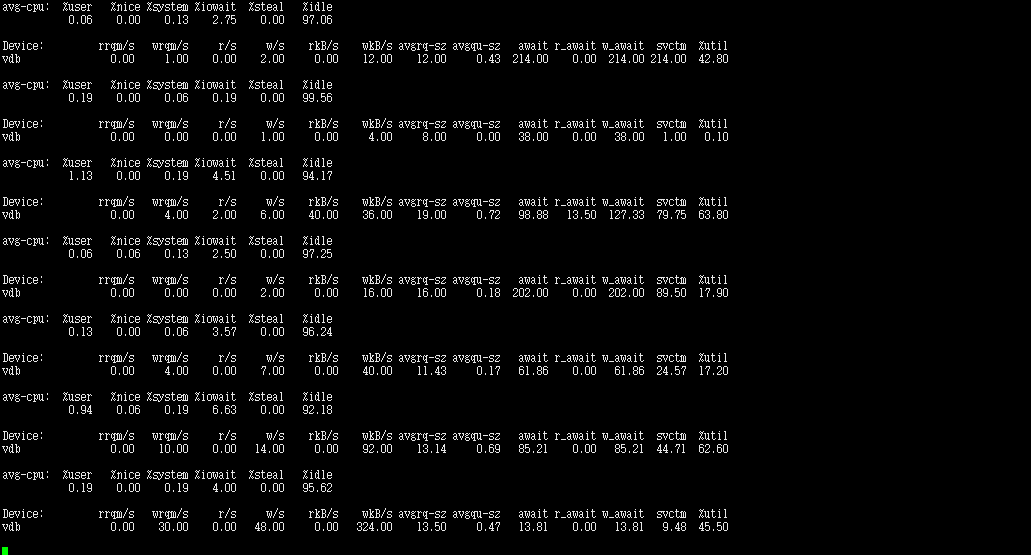

iostat 看下 读、写 的IO 等待高不高

那你是这么解决的

就这个节点有问题

你有问题的这个节点io 等待较高, 这个的看看磁盘具体性能

问题节点 负载大吗?

grafana 监控 tikv details— raft propose —propose wait duration per server

grafana 监控 tikv details— raft IO —append log duration

grafana 监控 tikv details— raft IO —commit log duration

grafana 监控 tikv details— raft propose—apply wait duration

grafana 监控 tikv details— raft IO —apply log duration

你看看这几个监控项 IO 情况,如果不高的话, 可能就是硬件性能不好

重启了tikv,去掉一个节点后,发现又出现一台IO高的服务器,这次是 PD节点

您好,这个集群运行多久了?这样的情况是第一次发生吗?还是有规律的发生多次了?

prewrite 29s,感觉是硬件没达到要求,先检查一下磁盘性能是否满足要求。

通过

sudo fio -ioengine=psync -bs=32k -fdatasync=1 -thread -rw=randread -size=10G -filename=fio_randread_test -name='fio randread test' -iodepth=4 -runtime=60 -numjobs=4 -group_reporting --output-format=json --output=fio_randread_result.json

测试的 rand read iops 不低于 40000

通过

sudo fio -ioengine=psync -bs=32k -fdatasync=1 -thread -rw=randrw -percentage_random=100,0 -size=10G -filename=fio_randread_write_test -name='fio mixed randread and sequential write test' -iodepth=4 -runtime=60 -numjobs=4 -group_reporting --output-format=json --output=fio_randread_write_test.json

测试的 rand read iops 不低于 10000

seq write iops 不低于 10000

通过

sudo fio -ioengine=psync -bs=32k -fdatasync=1 -thread -rw=randrw -percentage_random=100,0 -size=10G -filename=fio_randread_write_latency_test -name='fio mixed randread and sequential write test' -iodepth=1 -runtime=60 -numjobs=1 -group_reporting --output-format=json --output=fio_randread_write_latency_test.json

测试的 rand read lat 不高于 250000ns

seq write lat 不高于 30000ns