【 TiDB 版本】7.5.4

【 Bug 的影响】

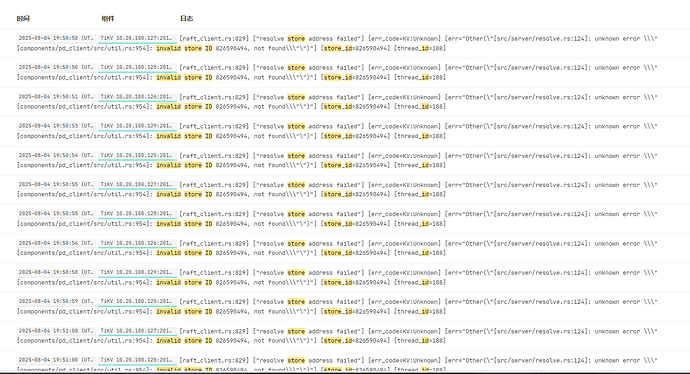

部分kv节点报错 invalid store ID,集群卡顿、不能正常使用。

【可能的问题复现步骤】

7月份出现过一次这个问题,部分kv报invalid store ID,表TIKV_STORE_STATUS和pd-ctl查询都未发现该id,重启报错kv后恢复正常。

隔了一个月又出现同样问题,同样重启kv后恢复。

最近几个月未发生过扩缩容和宕机等事件。

有检查过 TiKV 和 PD 网络隔离的情况吗? 同样问题是集中在部分节点有没有做 label 设置,看一下 PD 的 config all 结果发出来。

应该和网络无关,都是同一网段同一区域服务器,也没打标签

{

“replication”: {

“enable-placement-rules”: “true”,

“enable-placement-rules-cache”: “false”,

“isolation-level”: “”,

“location-labels”: “”,

“max-replicas”: 3,

“strictly-match-label”: “false”

},

“schedule”: {

“enable-cross-table-merge”: “true”,

“enable-diagnostic”: “false”,

“enable-joint-consensus”: “true”,

“enable-tikv-split-region”: “true”,

“enable-witness”: “false”,

“high-space-ratio”: 0.7,

“hot-region-cache-hits-threshold”: 4,

“hot-region-schedule-limit”: 8,

“hot-regions-reserved-days”: 7,

“hot-regions-write-interval”: “10m0s”,

“leader-schedule-limit”: 400,

“leader-schedule-policy”: “count”,

“low-space-ratio”: 0.8,

“max-merge-region-keys”: 50000,

“max-merge-region-size”: 10,

“max-movable-hot-peer-size”: 512,

“max-pending-peer-count”: 80,

“max-snapshot-count”: 40,

“max-store-down-time”: “30m0s”,

“max-store-preparing-time”: “48h0m0s”,

“merge-schedule-limit”: 64,

“patrol-region-interval”: “100ms”,

“region-schedule-limit”: 3600,

“region-score-formula-version”: “”,

“replica-schedule-limit”: 80,

“slow-store-evicting-affected-store-ratio-threshold”: 0.3,

“split-merge-interval”: “1h0m0s”,

“store-limit-version”: “v1”,

“switch-witness-interval”: “1h0m0s”,

“tolerant-size-ratio”: 0,

“witness-schedule-limit”: 4

}

github看了下已经有人提过bug了

https://github.com/tikv/tikv/issues/17875

https://github.com/tikv/tikv/pull/18023

还是merge状态未修复。

我这边低版本集群遇到这个问题会影响sql执行性能

如果触发这个bug会引起kv卡死,整个集群都用不了。目前只能重启报错的kv别让他死循环来解决。

是的,目前只能重启

此话题已在最后回复的 7 天后被自动关闭。不再允许新回复。