【TiDB 使用环境】生产环境

【TiDB 版本】8.5.3

【操作系统】

【部署方式】华为云/3台16核64G内存28T硬盘

【集群数据量】80T

【集群节点数】3节点

【遇到的问题:生产环境想部署tidb,目前有3台机器,对数据安全不敏感,数据主要是用来做分析,允许数据丢失,请问应该如何部署才能充分利用3台服务器的存储,目标存储数据量为80T左右】

1 个赞

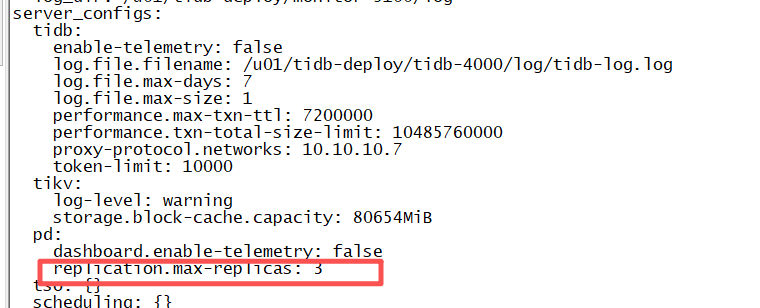

replication.max-replicas参数设置为1,所有数据保持1份副本,可以存放84T的数据

2 个赞

好的 谢谢

1 个赞

三台机器?那不是所有的节点都只能放这三台机器上了,数据量属实有点大

1 个赞

是的 目前项目启动阶段,预算有限,等后面赚钱了再扩大规模

1 个赞

第一次接这么大数据量的项目,团队都没啥经验 ![]()

1 个赞

一开始还想买个48核192G的服务跑单机 ![]()

1 个赞

集群部署文件我这么写可以不,目前磁盘做lvm都挂在到/data目录下了

global:

user: “tidb”

ssh_port: 22

deploy_dir: “/data/tidb-deploy”

data_dir: “/data/tidb-data”

log_dir: “/data/tidb-deploy/log”

replication:

max-replicas: 1

pd_servers:

- host: 10.153.220.138

name: “pd-1”

client_port: 2379

peer_port: 2380

deploy_dir: “/data/tidb-deploy/pd-2379”

data_dir: “/data/tidb-data/pd-2379”

log_dir: “/data/tidb-deploy/pd-2379/log” - host: 10.153.220.170

name: “pd-2”

client_port: 2379

peer_port: 2380

deploy_dir: “/data/tidb-deploy/pd-2379”

data_dir: “/data/tidb-data/pd-2379”

log_dir: “/data/tidb-deploy/pd-2379/log” - host: 10.153.220.67

name: “pd-3”

client_port: 2379

peer_port: 2380

deploy_dir: “/data/tidb-deploy/pd-2379”

data_dir: “/data/tidb-data/pd-2379”

log_dir: “/data/tidb-deploy/pd-2379/log”

tidb_servers:

- host: 10.153.220.138

port: 4000

status_port: 10080

deploy_dir: “/data/tidb-deploy/tidb-4000”

log_dir: “/data/tidb-deploy/tidb-4000/log” - host: 10.153.220.170

port: 4000

status_port: 10080

deploy_dir: “/data/tidb-deploy/tidb-4000”

log_dir: “/data/tidb-deploy/tidb-4000/log” - host: 10.153.220.67

port: 4000

status_port: 10080

deploy_dir: “/data/tidb-deploy/tidb-4000”

log_dir: “/data/tidb-deploy/tidb-4000/log”

tikv_servers:

- host: 10.153.220.138

port: 20160

status_port: 20180

deploy_dir: “/data/tidb-deploy/tikv-20160”

data_dir: “/data/tidb-data/tikv-20160”

log_dir: “/data/tidb-deploy/tikv-20160/log” - host: 10.153.220.170

port: 20160

status_port: 20180

deploy_dir: “/data/tidb-deploy/tikv-20160”

data_dir: “/data/tidb-data/tikv-20160”

log_dir: “/data/tidb-deploy/tikv-20160/log” - host: 10.153.220.67

port: 20160

status_port: 20180

deploy_dir: “/data/tidb-deploy/tikv-20160”

data_dir: “/data/tidb-data/tikv-20160”

log_dir: “/data/tidb-deploy/tikv-20160/log”

monitoring_servers:

- host: 10.153.220.138

deploy_dir: “/data/tidb-deploy/prometheus-9090”

data_dir: “/data/tidb-data/prometheus-9090”

log_dir: “/data/tidb-deploy/prometheus-9090/log”

grafana_servers:

- host: 10.153.220.138

port: 3000

deploy_dir: “/data/tidb-deploy/grafana-3000”

log_dir: “/data/tidb-deploy/grafana-3000/log”

登录数据库 set config replication.max-replicas=1 就行

不用配置文件改

1 个赞

项目刚启动就这么大数据量了么 ![]()

好的 谢谢 我在这配置下

要存小20万辆车的驾驶数据和轨迹数据,预估了下一年的数据量

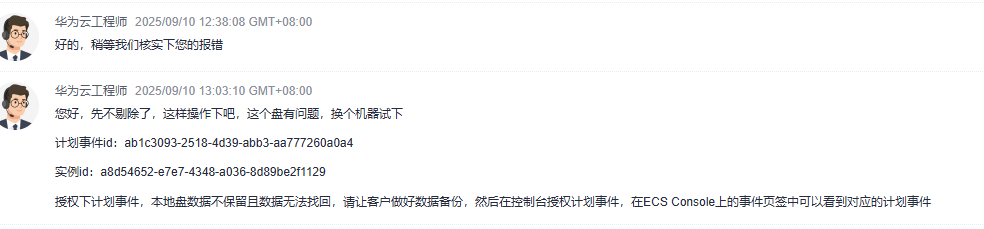

现在有新问题了,华为云的本地盘有问题,说要换新物理机

请问如果8个本地盘我划分成4个lvm,然后部署的时候没个节点部署4个kv,然后对应4个lvm盘是不是可行呀,这样假设后面运行过程中某个本地盘坏了是不是就重新部署下这个kv就可以了呀,其他的kv数据是不是还存在

此话题已在最后回复的 7 天后被自动关闭。不再允许新回复。