flying_cat

(Ti D Ber Kq8s Y Xr N)

1

【TiDB 使用环境】测试

【TiDB 版本】v8.5.3

【操作系统】 linux/x86_64

【部署方式】云下

【集群数据量】

【集群节点数】

【问题复现路径】

【遇到的问题:问题现象及影响】

【资源配置】进入到 TiDB Dashboard -集群信息 (Cluster Info) -主机(Hosts) 截图此页面

【复制黏贴 ERROR 报错的日志】

【其他附件:截图/日志/监控】

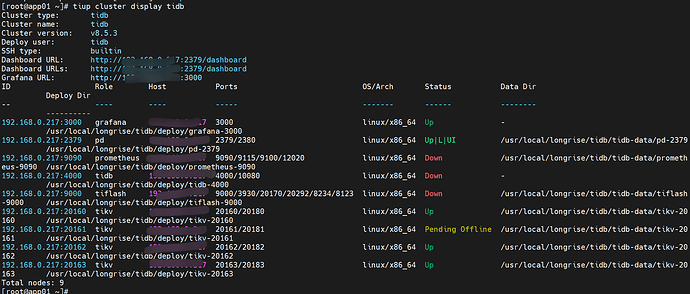

发现tikv节点无法启动,20161一直处于 Pending Offline 状态,并且tidb等其他组件无法启动,强制下线20161后,又新扩容了20163,20163是正常,现在就是想下线20161,以及启动tidb等其他组件。

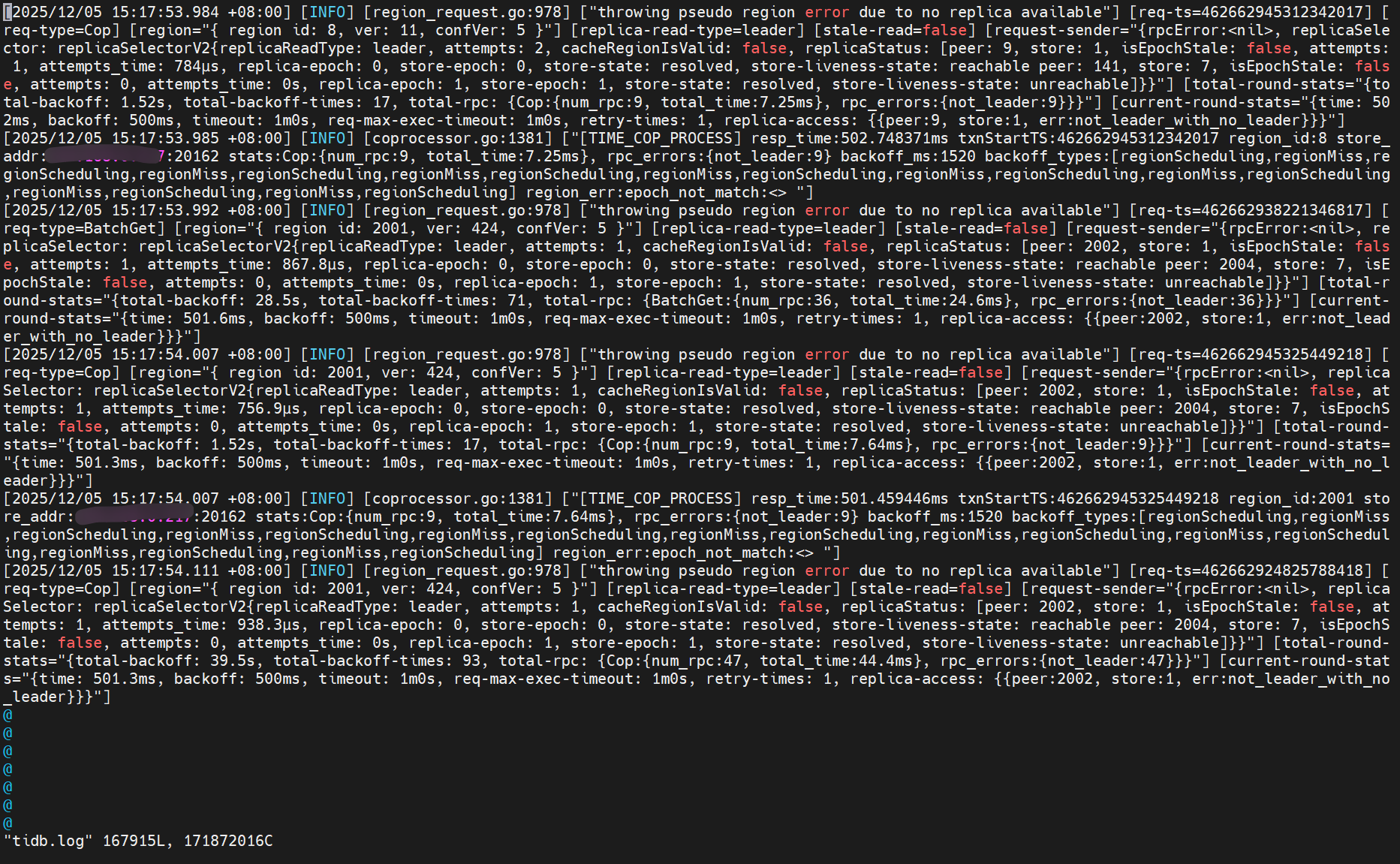

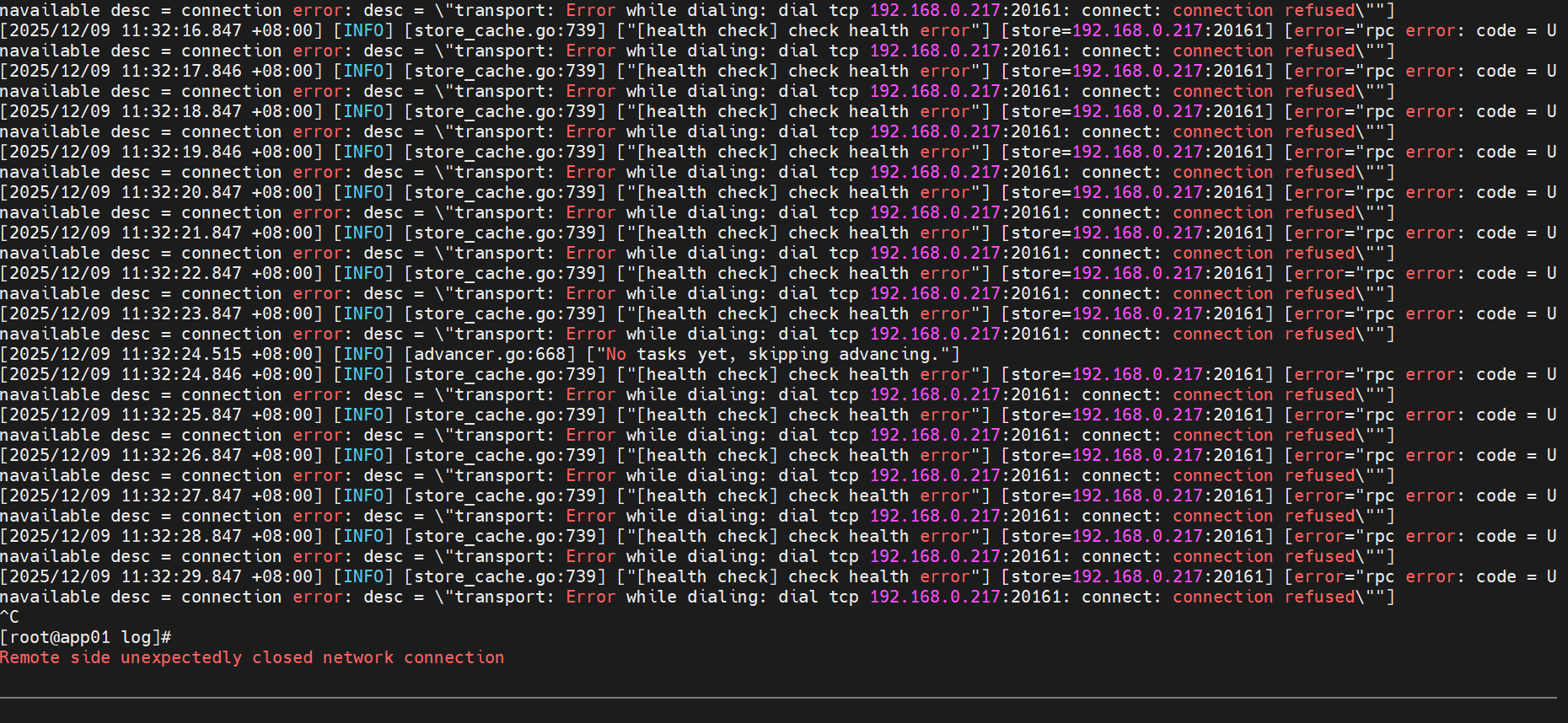

前者为现在集群状态,后者为启动tidb时日志报错

日志中的错误主要表现为“no replica available”和“not leader”,这通常意味着在分布式系统中,某个区域(region)没有可用的副本(replica)或者当前节点不是该区域的领导者(leader)

1 个赞

可以使用系统提供的工具或命令(如pd-ctl )来查看下副本的健康状况和状态。

Kongdom

(Kongdom)

8

tiup cluster start tidb 的时候,有什么错误信息?

纯白镇的小智

(Ti D Ber Qm Qja01 M)

9

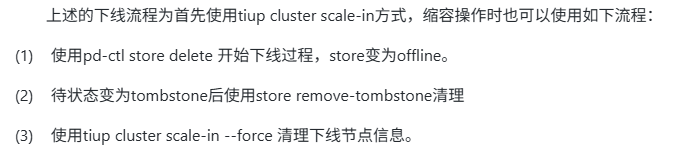

临时调低副本数可快速恢复 TiDB 启动,启动后需调回默认值保证数据高可用

flying_cat

(Ti D Ber Kq8s Y Xr N)

12

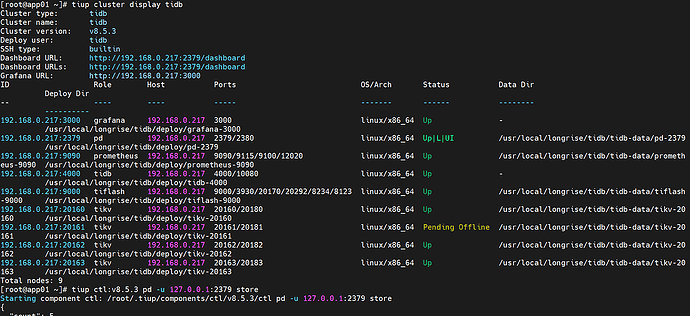

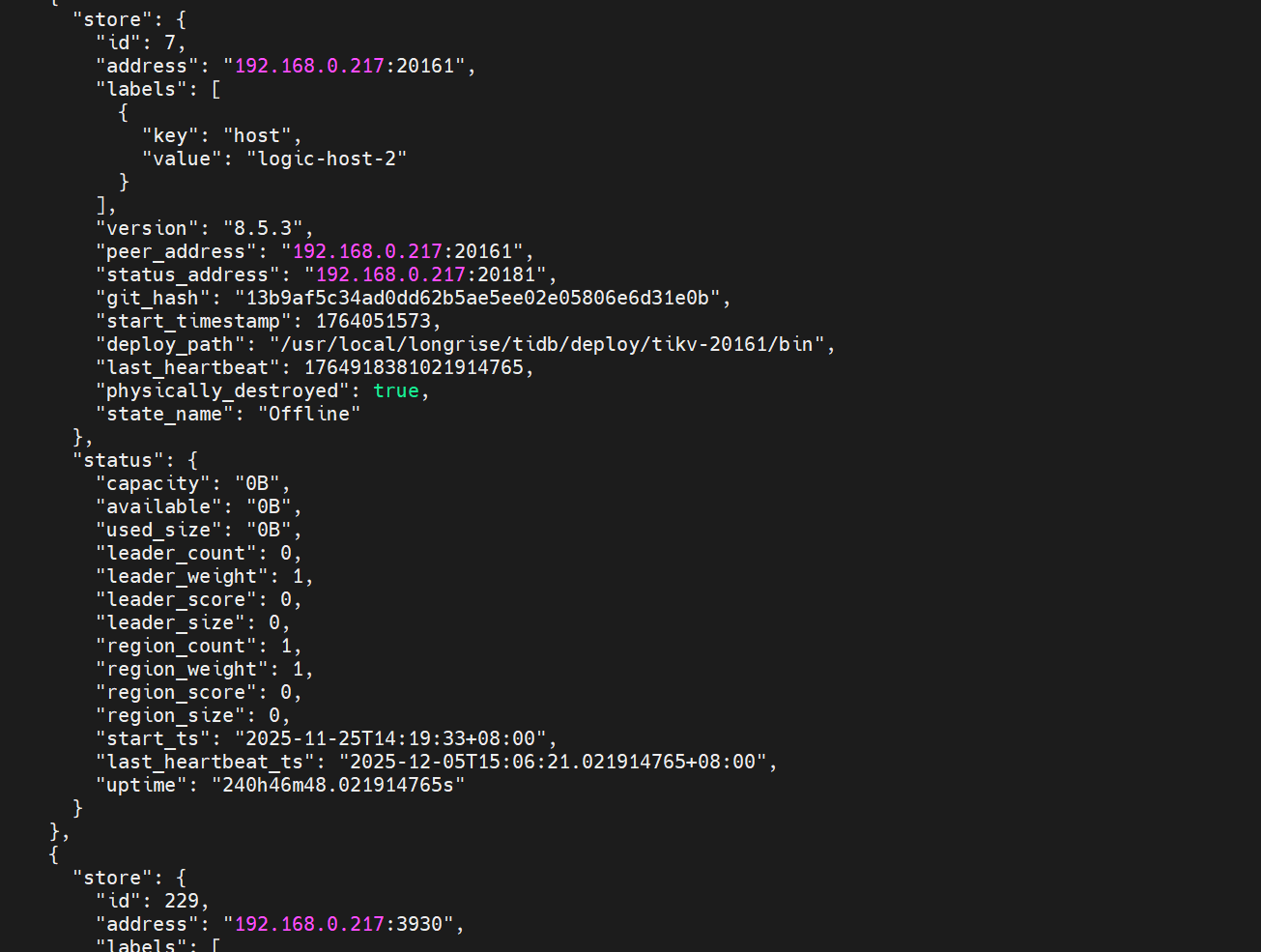

请问我现在是把tikv节点想剔除了,我其他的节点都是正常的,现在库也起来了,并且数据也都是正常的,我按照网上的说法把剔除20161,并且数据目录也清理了,但是display也是还是存在的,是哪里还有问题吗 并且tidb的日志还在报连接20161的报错。

flying_cat

(Ti D Ber Kq8s Y Xr N)

18

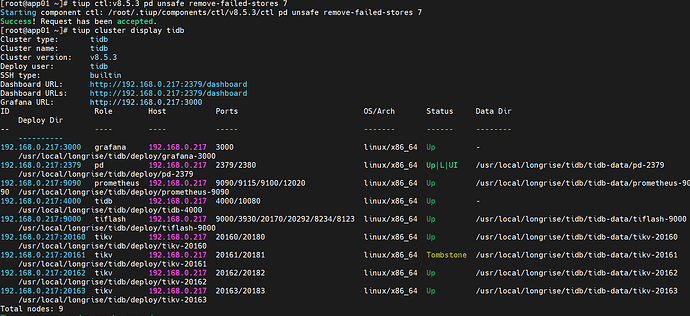

最终使用了 tiup ctl:v8.5.3 pd unsafe remove-failed-stores 7,该tikv状态已变为了Tombstone,后面顺利移除了,谢谢老师。

system

(system)

关闭

20

此话题已在最后回复的 7 天后被自动关闭。不再允许新回复。