【 TiDB 使用环境】生产环境

【 TiDB 版本】5.1.4

【遇到的问题:问题现象及影响】

1、收到了这样的告警,告警持续了几分钟

ticdc_memory_abnormal

状态:firing,级别:warning

TiCDC heap memory usage is over 10 GB

cluster: tidb-prod, instance: 127.0.0.1:8300, values:1.6023378784e+10,首次告警:2023-09-02T14:03:58

2、目标端是kafka

3、想咨询下ticdc写到kafka这个链路,有没有丢数据的可能性?常见的可能性有哪些?

我补充下我怀疑的点:

1、数据量大时,ticdc会不会处理不过来,把数据丢了?

2、ticdc写入kafka,成功写入判断是收到kafka ack吗?

RenlySir

(Renly Sir)

6

1、ticdc处理不过来的时候,只是会写入慢或者报错,但不可能丢失数据;

2、ticdc v7支持了单行校验

感谢感谢!

1、ticdc如果崩了,也不会丢吧?

2、我当前使用的版本是V5

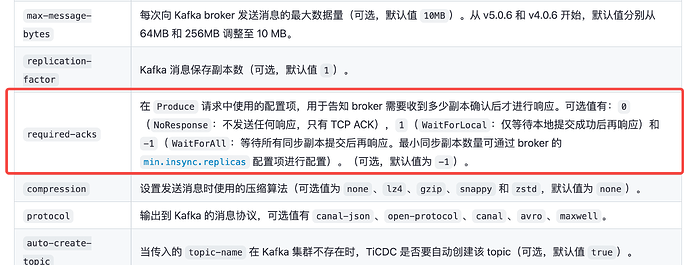

3、ticdc写入kafka,写入成功判断是收到kafka ack吗?还是说可以配置“写入成功判断”的策略?

RenlySir

(Renly Sir)

9

1、ticdc崩了,恢复时候具备断点续传能力,这个是ticdc具备的;

2、关于ack可以查看下面的截图

3、ticdc要求很高的话,建议升级到tidb v7.1.x,tidb和ticdc都会有不一样的使用体验的。

ack

required-acks参数是ticdc新版本才有的吗? V5.2版本好像没有,帮忙确认下5.2版本ack策略是什么?

路在何chu

(Ti D Ber Ass Gn Qs R)

13

丢数据,不至于吧,除非你自己的操作问题,或者你cdc单节点宕机,tso没有问题,不会丢数据